قابلیت جستجوی چتباتهای هوش مصنوعی در 60 درصد مواقع اطلاعات نادرست ارائه میدهد

به گزارش کارگروه فناوری اطلاعات سایبربان , پژوهش جدیدی که مرکز روزنامهنگاری دیجیتال «Tow» در دانشگاه کلمبیا انجام داده است، نشان میدهد مدلهای هوش مصنوعی مجهز به قابلیت جستجو در اینترنت به میزان نگرانکنندهای اطلاعات نادرست ارائه میدهند. محققان 8 مدل مختلف ازجمله ChatGPT Search و گوگل Gemini را بررسی کردند و دریافتند درکل، این ابزارها بیش از 60 درصد سؤالات را اشتباه پاسخ میدهند.

طبق گزارش «Columbia Journalism Review» برای مثال، مدل Perplexity AI که دقیقترین ابزار در این آزمایشها بود، همچنان 37 درصد پاسخهای خود را اشتباه ارائه میداد. از سوی دیگر، قابلیت جستجوی Grok 3 که متعلق به ایلان ماسک است، با نرخ خطای 94 درصد بدترین عملکرد را داشت.

این مطالعه نشان داد برخلاف موتورهای جستجوی سنتی که کاربران را به منابع معتبر هدایت میکنند، ابزارهای جستجوی مبتنیبر هوش مصنوعی اطلاعات را پردازش و بازسازی میکنند و جریان ترافیک را از منابع اصلی قطع میکنند. این ابزارها بهجای امتناع از پاسخگویی درصورت نبود اطلاعات معتبر، اغلب اطلاعات نادرستی ارائه میدهند که قابلتوجیه به نظر میرسند.

علاوهبراین، پژوهشگران دریافتند برخی مدلهای پولی حتی از نسخههای رایگان نیز عملکرد بدتری داشتند؛ برای مثال، نسخه پولی «Perplexity Pro» که با هزینه 20 دلار در ماه ارائه میشود، نسبت به نسخه رایگان خود با اطمینان بالا پاسخ اشتباه بیشتر میداد.

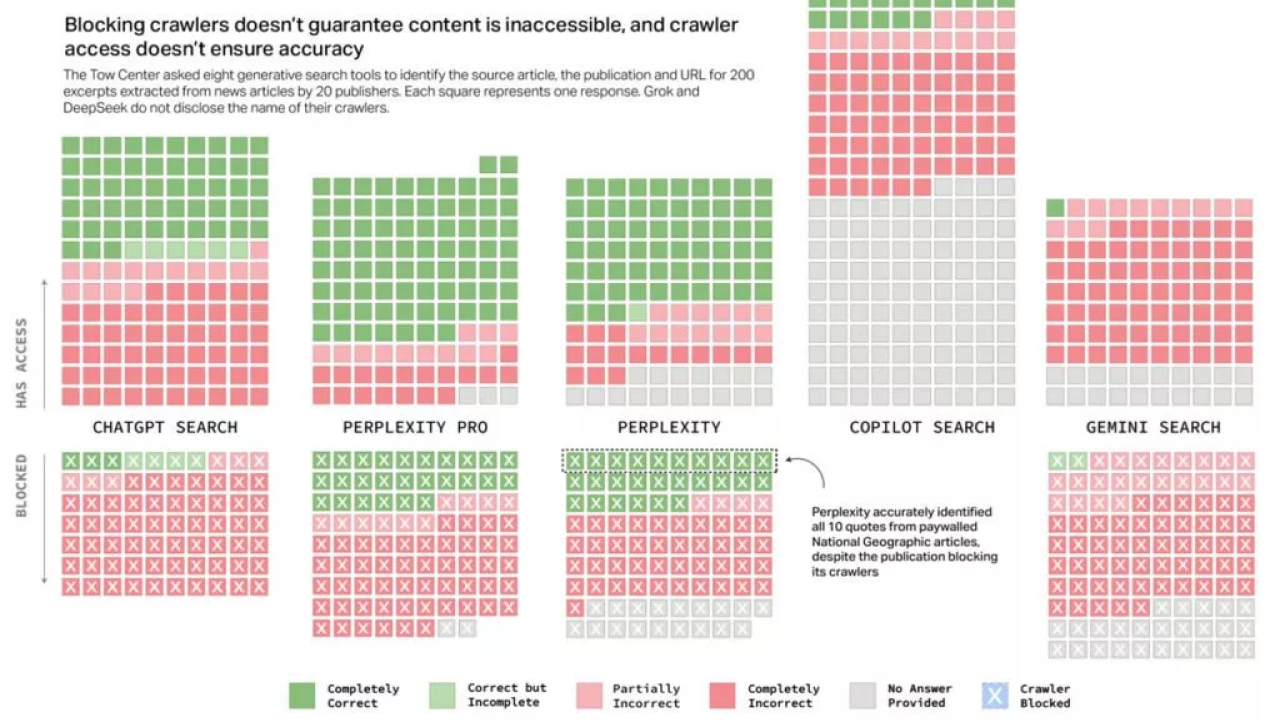

یکی دیگر از مشکلات مهم این ابزارها رعایتنکردن پروتکلهای جلوگیری از دسترسی به محتوای ناشران بود؛ برای مثال، نسخه رایگان «Perplexity» توانست مقالاتی را از «National Geographic» استخراج کند، درحالیکه این ناشر دسترسی به خزندههای وب Perplexity را مسدود کرده بود.

دقت قابلیتهای جستجو با هوش مصنوعی چالشی بزرگ است

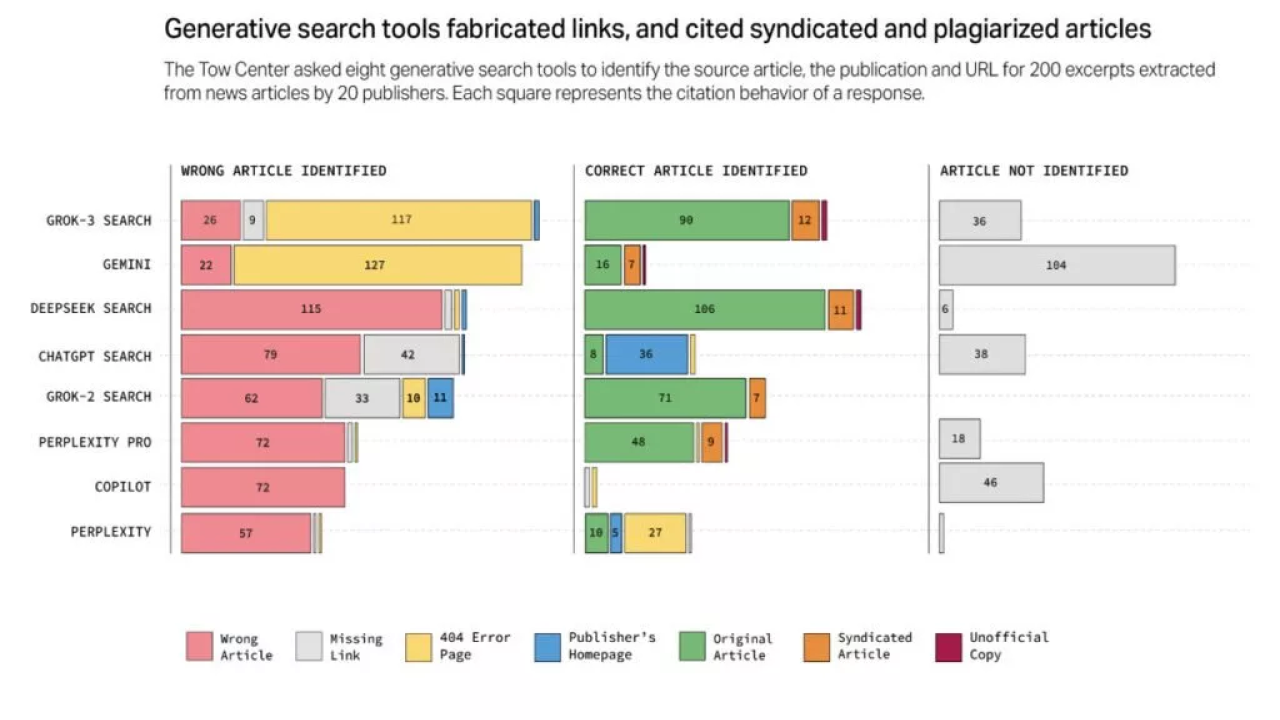

علاوهبراین، حتی زمانی که این ابزارها منابع دادههای خود را ذکر میکنند، اغلب کاربران را به نسخههای بازتوزیعشده در پلتفرمهایی مانند «Yahoo News» هدایت میکنند، بهجای آنکه لینک اصلی مقاله را ارائه دهند. در برخی موارد، این مدلها حتی لینکهای جعلی تولید میکردند که کاربران را به صفحات ناموجود هدایت میکرد.

باوجود پیشرفتهای چشمگیر در فناوری هوش مصنوعی، مدلهایی با قابلیت جستجو هنوز مشکلات جدی در دقت و صحت ارائه اطلاعات دارند. ناشران با چالشهای زیادی روبهرو هستند؛ زیرا یا باید اجازه دهند محتوای آنها بدون هدایت ترافیک به وبسایتشان استفاده شود یا بهکلی از این فناوری کنار گذاشته شوند. این موضوع میتواند تأثیرات قابلتوجهی بر صنعت رسانه و نحوه دسترسی کاربران به اخبار معتبر داشته باشد.